昨今、 ChatGPT のビジネス活用が拡大しています。一方で ChatGPT には、データを学習することによる情報漏洩の可能性や、知的財産権の侵害、誤情報の拡散といったリスクがあることは否定できません。

この記事では、AIを活用した具体的な業務効率化の事例と、AI導入のための重要なポイントについて解説します。

-

1ChatGPTのセキュリティリスク

情報漏洩、知的財産権侵害、誤情報の拡散、サイバー攻撃といったリスクがある。

-

2ChatGPTを安全にビジネス活用するための対策

学習させるデータに注意を払う、API連携によりセキュアな環境で使用する、サーバのセキュリティを強化する。

-

3セキュリティリスクを抑えるなら、法人向けサービスを検討

Safe AI Gateway は、企業が生成AIを安全・簡単に利用できるように開発したサービスです。

詳細は Safe AI Gateway のトップページをご確認ください。

ChatGPT は、進化する生成AIチャットボット

ChatGPT は、2022年11月にアメリカのOpenAIが発表した生成AIで、「進化する生成AIチャットボット」とも呼べる存在です。生成AIの仕組み自体はさらに前から存在しており、 ChatGPT にAIモデルとして搭載されている GPT の初期バージョンが開発されたのは2018年のことでした。

それまで一般的に知られていなかったGPTが一大ムーブメントを巻き起こしたのは、 ChatGPT がインターフェースにチャット形式を採用したことがきっかけです。

自然言語を用いたチャット形式で、まるで人と話しているかのような感覚で使えることから、 ChatGPT は社会現象と呼べるほど大きな話題を呼びました。

ChatGPT の基本原理と進化

ChatGPT は自然言語処理と呼ばれる技術を用いることで、人と人が話すように自然な言葉でやりとりできるのが最大の特徴です。自然言語とは、私たちが普段使っている言葉を指します。

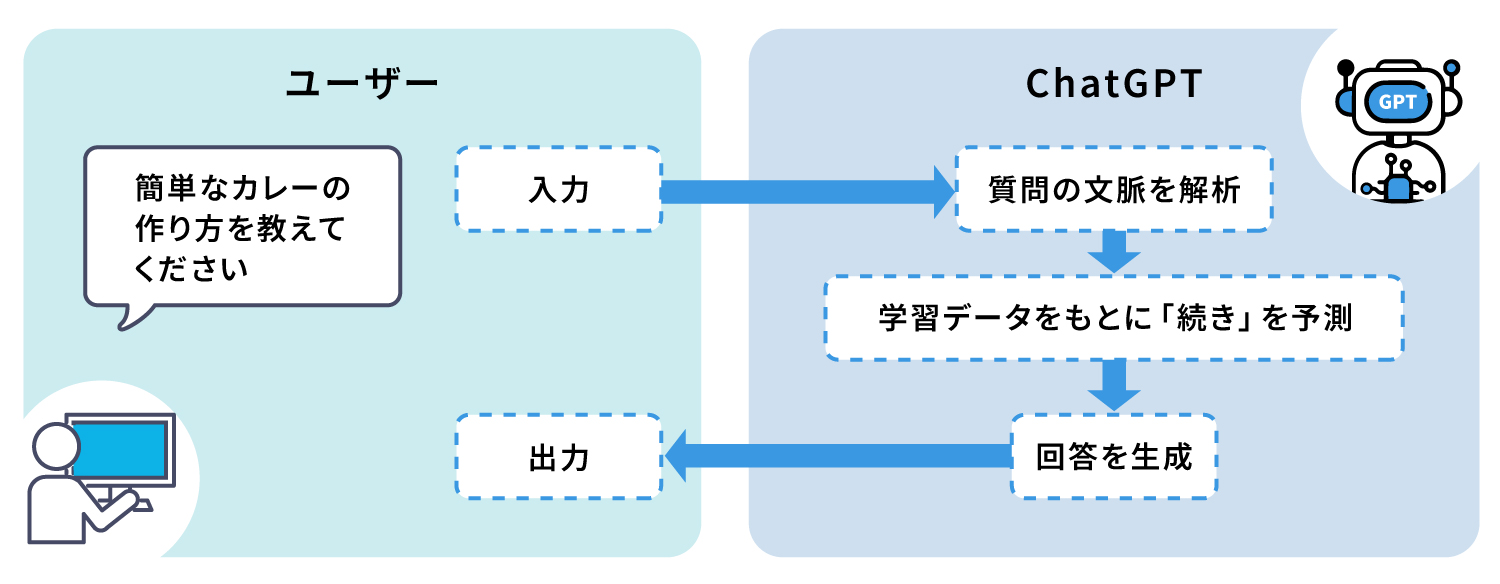

では、なぜ ChatGPT は、ユーザーが入力した内容に対して自然な応答ができるのでしょうか。それは、 ChatGPT が膨大なデータを学習しており、それをもとにユーザーが入力した文章(プロンプトと呼びます)の文脈を解析し、続きの言葉を予測して生成するからです。

例えば、「簡単なカレーの作り方を教えてください」と入力すると、 ChatGPT は与えられた文脈を解析し、それに応じた回答を生成します。ChatGPT は、膨大な学習データをもとに、ユーザーが求めているのが「具体的なカレーの材料や作り方の手順」であると予測しているのです。

この流れは一見すると、ユーザーの「質問」に対して ChatGPT が「回答」したように見えます。ですが、実際には ChatGPT が「続きを予測して応答している」のです。

ChatGPT はリリース後も、 GPT-3.5 、 GPT-4 と進化を続けており、2024年5月には GPT-4o というバージョンがリリースされました。 GPT-4 以降のバージョンを使用するには月額20ドルを支払う必要がありますが、 GPT-3.5 であれば無料で利用できます。

また、 GPT-4 以降では文章だけでなく画像やPDFなどのファイルを読み込んで、その内容をもとにやりとりすることも可能です。

ChatGPT のビジネス活用

ChatGPT は現在、ビジネスのさまざまなシーンで活用されています。例えば、レポートの作成やデータ分析、アイディア出し、提案などは ChatGPT が得意とするところです。

ChatGPT のセキュリティリスク

ChatGPT は便利なツールですが、ビジネスに活用するにはセキュリティリスクに注意しなければなりません。どのようなリスクがあるのか、具体的に解説します。

情報漏洩のリスク

ChatGPT は、ユーザーが入力した内容を学習し、回答の精度を高めていく仕組みになっています。これは、 ChatGPT が学習したデータが、別のユーザーへの回答に転用される可能性もあるということです。

もし、個人情報や財務情報などの機密情報を ChatGPT に入力すると、 ChatGPT が学習した機密情報を別のユーザーに対する出力に含めてしまうおそれがあるのです。

特に、顧客情報や個人情報については、流出させてしまうとプライバシーの侵害や個人情報保護法違反になる可能性があります。こうした機密情報については、 ChatGPT に学習させないような対策が必要です。

知的財産権侵害のリスク

ChatGPT はさまざまな既存コンテンツを学習しており、その内容を生成に活用する可能性があります。このことから、 ChatGPT が生成したコンテンツが既存コンテンツに類似することも考えられ、そのまま公開してしまうと知的財産権を侵害するおそれがあります。

例えば、企業ブログやオウンドメディアの記事を ChatGPT に生成させて、それをそのまま公開するようなことは避けるべきでしょう。 ChatGPT が生成したコンテンツを活用する場合は、必ず人の目でチェックし、手を入れることが重要です。

誤情報や偏った情報を拡散するリスク

ChatGPT が生成する回答は、必ずしも正しいとは限りません。やっかいなのは、誤った内容であっても書き口がかなりもっともらしいことです。なぜ、このようなことが起こるのかというと、前述したように ChatGPT は、「正しい答えを返す」仕組みではなく「ユーザーが入力した言葉の続きを予測して応答する」仕組みになっているからです。

つまり、文章が自然な流れになっていれば良く、内容の正誤をチェックする機能はありません。この「ChatGPT が堂々と嘘をつく」問題を、「ハルシネーション」と呼びます。

ハルシネーションによって生成された回答を、ファクトチェックせずに公開してしまうと、誤った情報を拡散してしまうことになりかねません。

サイバー攻撃のリスク

ChatGPT をビジネスに活用するときには、サイバー攻撃によるリスクも意識しておきましょう。 ChatGPT 自体はもちろんですが、 ChatGPT と連携しているサービスがサイバー犯罪者に攻撃されてしまうと、 ChatGPT が学習した自社のデータなどが漏洩する危険性があります。

また、 ChatGPT そのもののリスクではありませんが、 ChatGPT にサイバー攻撃のためのプログラムコードやスパムメールを生成させるというような悪用のケースも考えられます。

ChatGPT は、こうした悪質なプロンプトには応答しないように設計されていますが、その仕組みをかいくぐるケースも見られるため注意が必要です。

ChatGPT のセキュリティリスクに対する対策

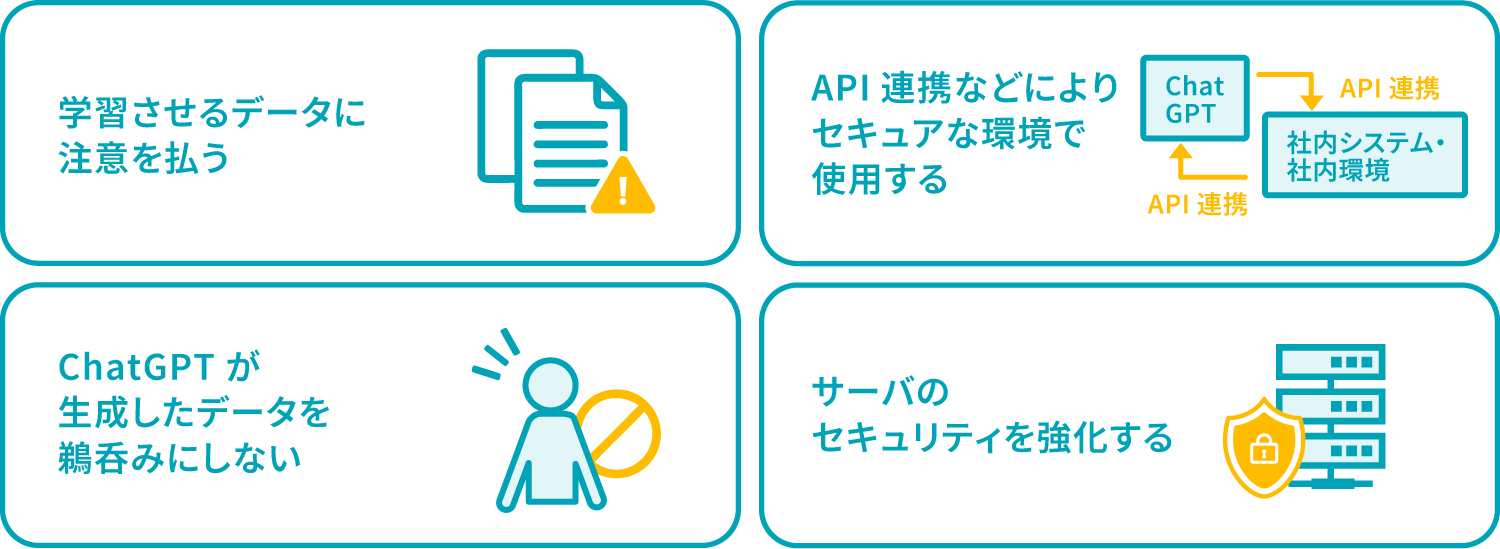

学習させるデータに注意を払う

ChatGPT に学習させるデータには、個人情報などの機密情報が含まれないようにします。業務で利用する場合は、利用に関するガイドラインなどを策定することが重要です。ガイドラインには、「どのような業務で利用するのか」「どのような内容なら入力していいのか、あるいはどのような内容を入力してはいけないのか」「生成した文章をどう利用するのか」といった内容を盛り込み、全社にルールを徹底させましょう。

通常、 ChatGPT は入力した内容を学習しますが、設定を変更することで学習機能をオフにすることも可能です。 ChatGPT の設定画面を開き、「データ コントロール」から「モデルの改善」を選択してオフに設定すれば、 ChatGPT を利用してもデータが学習に利用されることがなくなります。

以前は学習機能をオフにするとチャットの履歴が残せない仕様になっていましたが、現在はチャットの履歴が残るように改善されています。

API連携によりセキュアな環境で使用する

ChatGPT にデータを学習させずに使用する方法のひとつが、API連携を利用することです。API連携とは、異なるソフトウェア同士を連携させるための手法で、 ChatGPT はAPI連携機能として OpenAI API を提供しています。

OpenAI API を自社で利用するソフトウェアに組み込むと、ソフトウェア上に ChatGPT を呼び出して使用することができます。この際、ユーザーが入力した情報は ChatGPT のモデル学習には使用されず、 OpenAI API が秘密保持しているため、情報漏洩が防げるのです。

ChatGPT が生成したデータを鵜呑みにしない

前述したとおり、 ChatGPT は誤った内容の文章を生成することがあります。そのため、 ChatGPT が生成したデータを使用する場合は、その内容が間違っていないかどうかのファクトチェックが必要になります。知見が不足しているなどの理由でどうしてもファクトチェックが難しい場合は、 ChatGPT が生成した内容を利用するのは控えましょう。

ChatGPT は、プログラムコードを生成することもできますが、これもチェックせずにそのまま使用するのはリスクがあります。エンジニアなどの専門家にチェックを依頼してから利用するように心掛けることが大事です。

サーバのセキュリティを強化する

ChatGPT を利用したサービスがサイバー攻撃を受ける可能性も考え、サーバのセキュリティを強化しておく必要があります。

そもそも ChatGPT の利用の有無にかかわらず、セキュリティ対策は必須です。セキュリティ対策ソフトを導入したり、サイバーセキュリティを専門とする企業のアドバイスを受けたりするなど、しっかりとセキュリティが確保された環境で ChatGPT を使用することが重要です。

▼あわせて読みたい

チャットGPTの危険性とは?ビジネス活用のリスクと回避方法を解説

ChatGPT のセキュリティリスクに対策して、安全にビジネス活用しよう

ChatGPT は自然言語で扱える生成AIであり、ビジネスへの活用も拡大しています。その一方で、入力したデータを学習することによる情報漏洩や知的財産権の侵害、不正確な情報の生成など、セキュリティ面でのリスクも抱えています。

これらのリスクを解決するには、ガイドラインを設けたり学習機能をオフにしたりするほか、セキュアな環境で使用する、生成されたデータのファクトチェックをするといった対策が必要です。

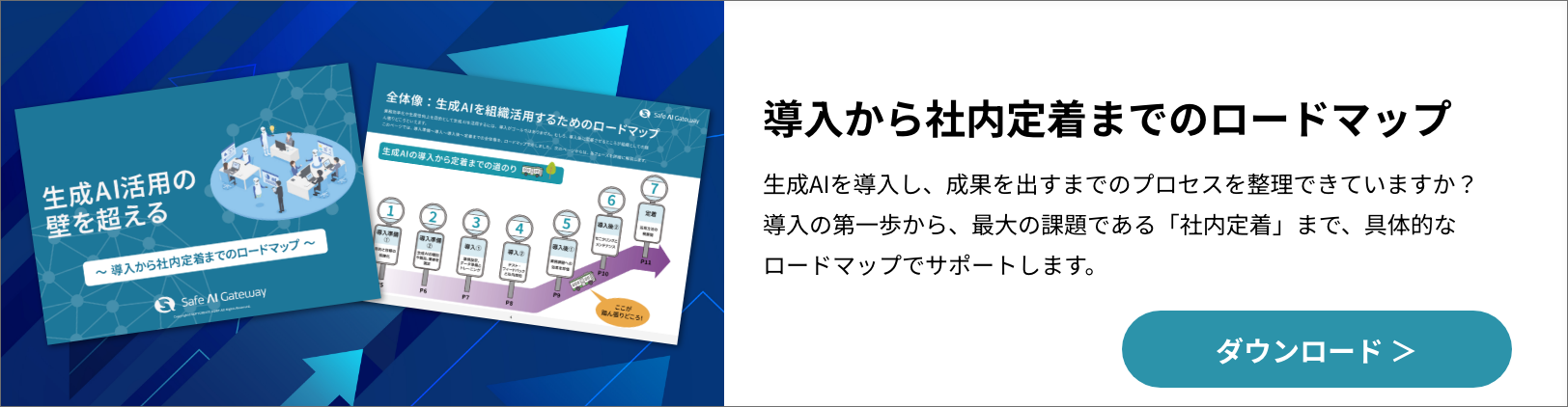

ソフトクリエイトが提供する Safe AI Gateway は、企業がChatGPTを安全・簡単に利用できるように開発されたサービスです。企業ごとに安全な専用環境を作ることで、セキュアな生成AI活用を実現します。また、自社データを利用した生成AI型のチャットボットを自社で簡単に作ることが可能です。

企業でのChatGPT導入をご検討中の企業様は、まずは無料トライアルで導入前の不安を解消してはいかがでしょうか。1ヶ月の無料トライアルは、下記のリンクからお申し込みください。